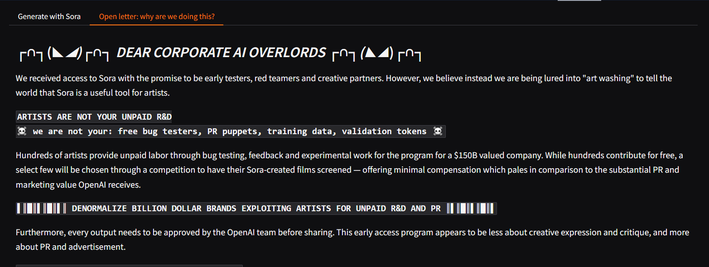

OpenAI 的 Sora 模型在未经授权的情况下被泄露,暴露了关于技术进步、伦理问题和公司责任的复杂争议。该泄露事件出现在 Hugging Face 平台,据称是由参与测试阶段的人员以“PR-Puppets”用户名进行泄露的,泄露的模型随同一封公开信一起发布,信中写道“致企业 AI 领主”,据称该模型能够生成 10 秒钟的高清视频片段,分辨率高达 1080p,此次事件引发了对创新和劳动关系的讨论。

什么是 Sora?

Sora 是 OpenAI 开发的生成式AI模型,能够将文本转换为高质量的视频,具备精确的文本与视觉对齐和增强的时间一致性。在 Hugging Face 讨论平台上,Sora 被描述为“技术精湛的展示”。该模型能够生成“视觉一致的叙事”视频,因而被赞誉为生成式 AI 的一项里程碑成就。尽管 Sora 展示了巨大技术潜力,但仍面临复制复杂物理现象和内容安全等挑战。

泄漏原因及涉嫌动机

Sora 模型泄漏的背后是创意产业工作者的不满,批评 OpenAI 未能合理补偿或认可他们的创意贡献,认为其做法像是对创意劳动的剥削。这些测试者,包括视觉艺术家和电影制作人,提供了宝贵的反馈和创意输入,却声称自己没有得到应有的认可或补偿。这一泄漏行为被视为对 AI 开发中创意工作商品化的抗议,揭露了 OpenAI 忽视艺术劳动经济价值的问题,呼应了 AI 伦理话语中已经存在的不满情绪。

道德与法律

Sora 的泄露引发了关于版权和知识产权的讨论,OpenAI 的训练数据使用及其版权问题引发质疑。OpenAI 此前因使用受版权保护的材料进行训练而受到审查,并以“合理使用”作为辩护。尽管OpenAI 声明 Sora 的训练数据包括授权和公共数据集,但公司对具体细节保持沉默,这让人产生了怀疑。并且,尽管 OpenAI 已实施安全措施,包括检测分类器和内容政策执行机制,但此次泄漏事件显示其无法完全防止模型滥用,进一步凸显技术进步与知识产权保护之间的矛盾。

对 AI 和创意产业的影响

Sora 的泄露象征着 AI 时代中更广泛的权力斗争。一方面,OpenAI 自我定位为创新与实用的先锋,Sora 代表着一个让视频创作普及的工具;另一方面,这次泄漏突显了系统性的问题,如对创意劳动的低估和 AI 依赖人类创意所带来的伦理困境。

正如 Hugging Face 上的另一位贡献者所说:“AI 不是在真空中存在的。它建立在那些往往未被认可的创意者的肩膀上。Sora 泄漏是一次警示:没有伦理的创新就是剥削。”

对于创意专业人士而言,这次泄漏是把双刃剑。它揭示了当前体系中的不平等,但也可能破坏艺术家与技术开发者之间的合作信任。展望未来,这一事件呼吁重新思考公司如何与创意社区互动,强调透明度、公正补偿和对知识产权的尊重。

教训

Sora 的泄漏突显了生成型 AI 面临的伦理问题,并为行业如何平衡创新与保护人类劳动提供了重要教训。OpenAI的处理方式可能为未来组织的伦理决策设定先例。

最终,Sora的争议是AI行业面临的更大挑战的缩影:如何在追求进步的同时,尊重并保护支撑这一进步的人类劳动。正如Hugging Face上的一位观察者简洁地总结道,“这不仅仅是一次泄漏;它是一次审视。”

关注 TopsTip:X/Twitter

TopsTip

TopsTip