苹果展示了一个新的搜索体验,叫做“Apple Visual Intelligence”,使用体验感类似于 Google Lens,但它使用 iPhone 自带的摄像头,并直接内置于 Apple Intelligence 中。

它似乎还使用了第三方搜索提供商,比如 Google、OpenAI 的 ChatGPT 和 Yelp,搜索结果取决于查询类型。

外观和功能

以下是苹果活动中的一些截图,你可以观看苹果 9 月 10 日的新品发布会,视频大约从 57 分钟开始展示这些功能:

当你在街上看到一辆自行车想买时,拍照后系统显示“使用Google搜索…”:

搜索结果看起来有点“修饰”过。

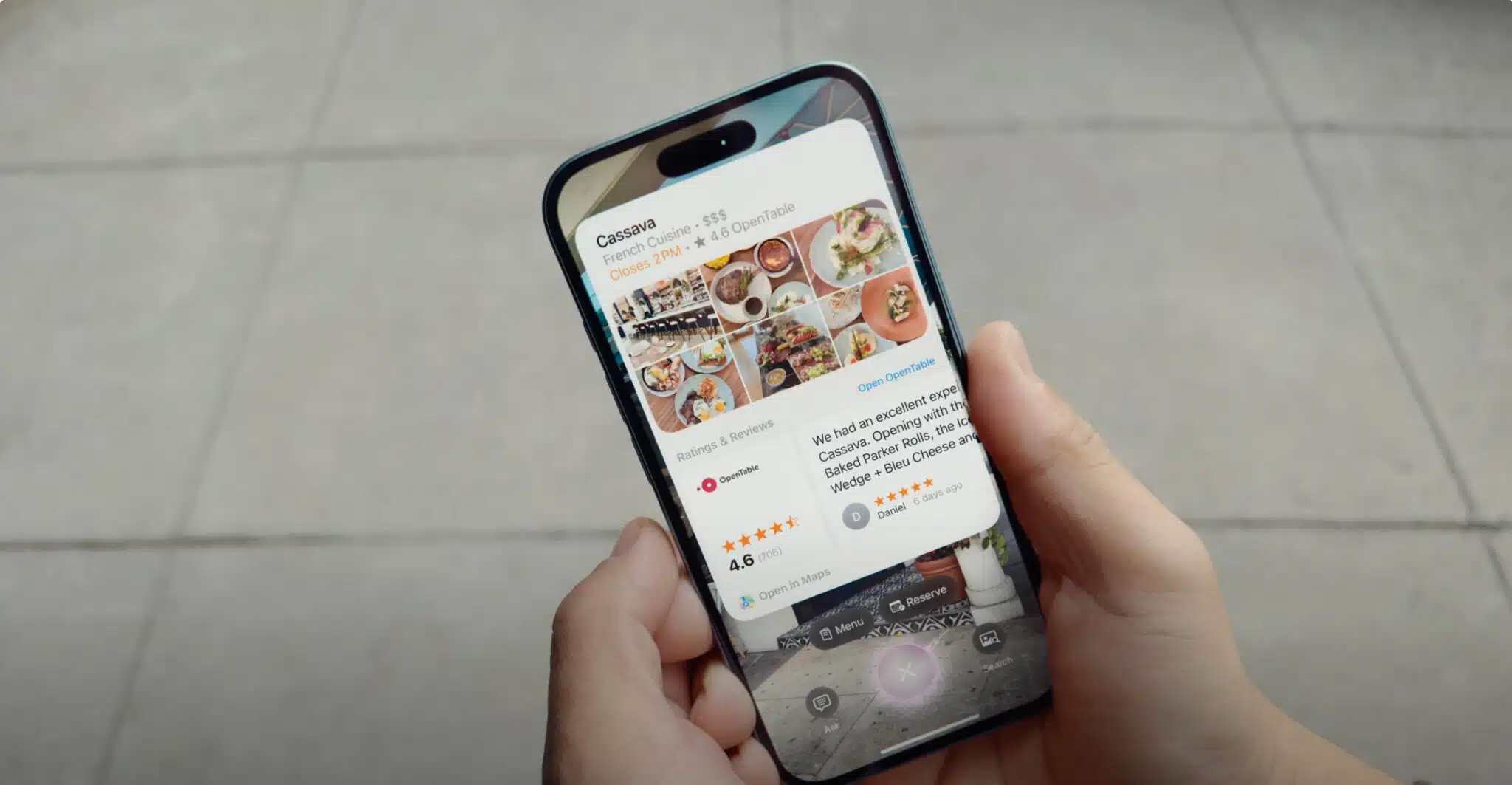

这里有一个本地搜索的例子,当你走路时路过餐馆,想了解更多信息,本地搜索结果会通过 Apple Maps 显示,我认为这些数据似乎是由 Yelp 和 OpenTable 提供支持。

近距离截图显示了 OpenTable 在 Apple Maps 中的选项。

如果你用它来拍摄作业照片时,它会使用 OpenAI 的 ChatGPT 来帮助解答问题。

小结

苹果似乎将 AI 作为一种工具,而不是设备的基础,虽然集成了 Google、OpenAI 和其他搜索提供商。但显然,苹果设备上有底层的 AI 和机器学习在运行,而搜索结果主要来自第三方。

尽管苹果的 AI 工具展示了整合能力,但早期评测指出其仍存在一些问题,如误判优先邮件和“幻觉”现象。

TopsTip

TopsTip